Píše sa rok 2035 a roboty sú súčasťou takmer každej domácnosti. Riadia sa základnými pravidlami, ktoré im definoval spisovateľ Izák Assimov už v päťdesiatych rokoch 20. storočia vo svojej poviedke Runaround. Sú jednoduché:

- Robot nesmie ublížiť človeku alebo svojou nečinnosťou dopustiť, aby mu bolo ublížené.

- Robot musí poslúchnuť človeka, okrem prípadov, keď je to v rozpore s prvým zákonom.

- Robot sa musí chrániť pred poškodením, okrem prípadov, keď je to v rozpore s prvým alebo druhým zákonom.

Niektoré z nich sa však rozhodli, že sa nimi prestanú riadiť a skúsia ovládnuť svet. Našťastie, iba vo filmovom spracovaní, ktoré poznáme pod názvom „Ja Robot”.

Realita

Hoci v úvode hovoríme o sci-fi predstave, umelá inteligencia a počítače sa už aj dnes musia veľmi jasne a rýchlo rozhodnúť v rôznych životu nebezpečných okolnostiach. Na prvý pohľad jednoduché pravidlá tak dostávajú zaťažkávaciu skúšku.

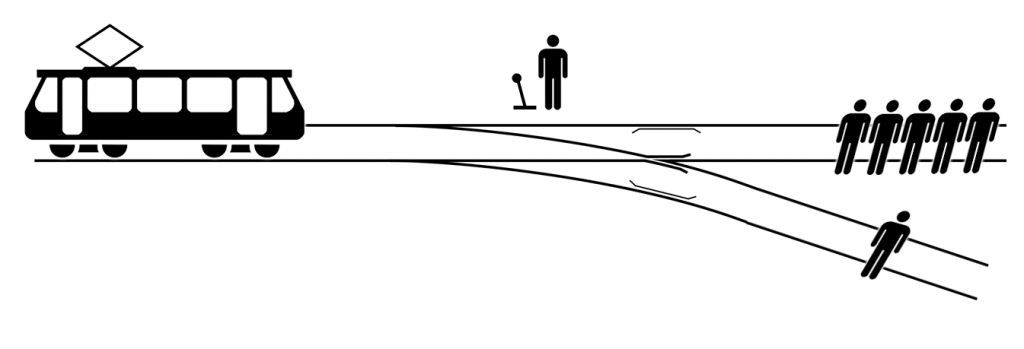

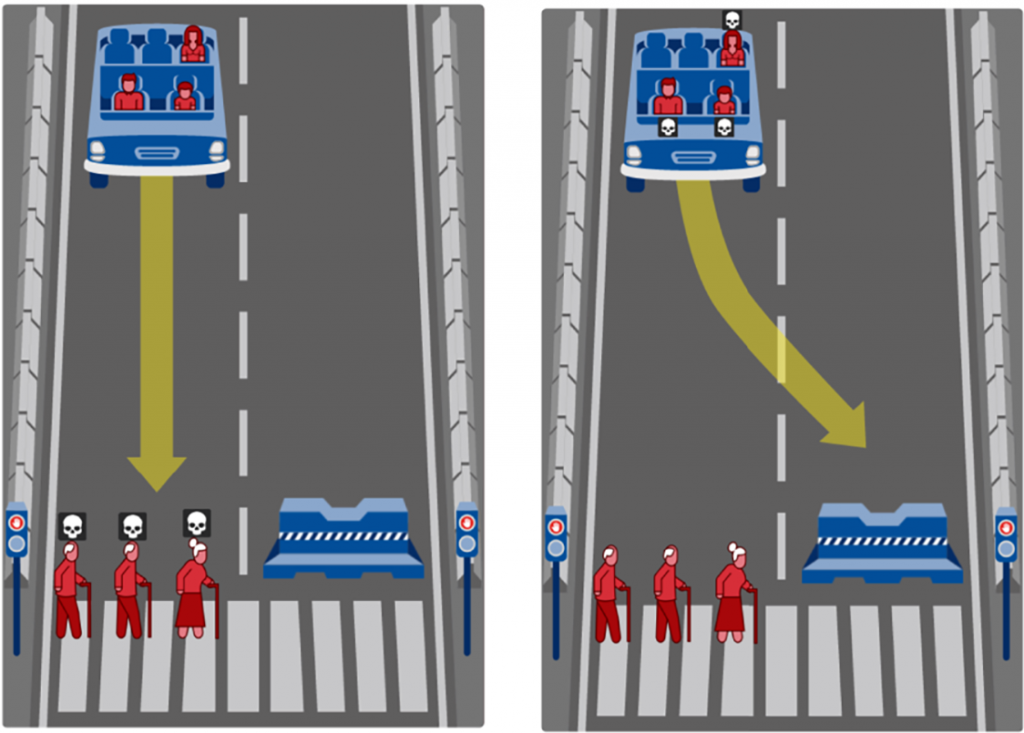

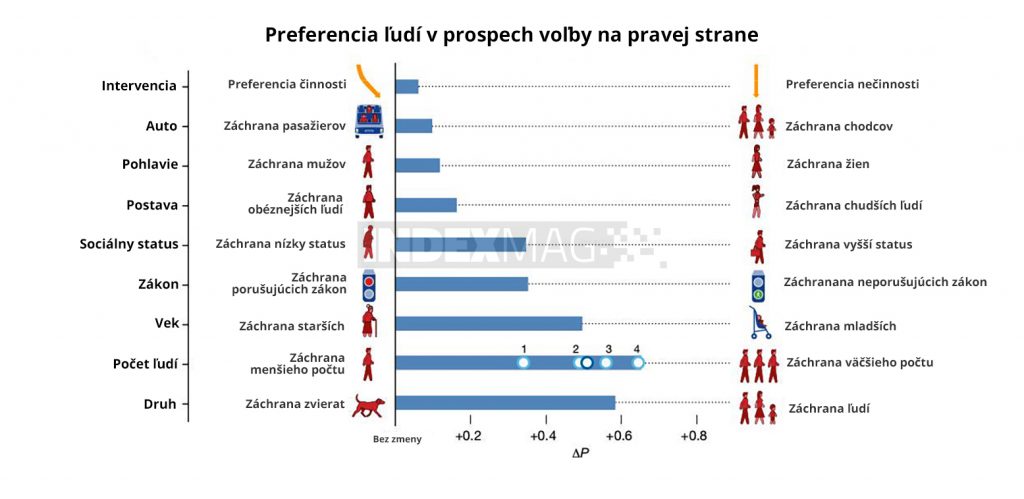

Autonómne automobily, ktoré neustále vyhodnocujú situáciu okolo seba, sa môžu dostať do situácie, kedy je ublíženie človeku nezvratné. Ako sa majú v tomto prípade rozhodnúť? Je morálnejšie a etickejšie obetovať jedného človeka, aby ste zachránili ďalších piatich? Túto otázku si kládol aj filozof Philipp Foot takmer pred 50 rokmi v experimente známom aj ako „The trolley dilemma“.

Počítače nemajú pud sebazáchovy. Nerozhodujú sa v poslednej sekunde na základe pocitov alebo náhody. Postup majú naprogramovaný. Ako ich teda naučiť rozmýšľať eticky a morálne, aby sa zachovali v takýchto situáciách rovnako ako človek a navyše ešte správne?

[…] Vývoj aplikácie, ktorá dokáže dôsledne a správne identifikovať druh, je ambicióznym prvkom umelej inteligencie. Cez algoritmus, kódovaný rozhodovací proces, musia prejsť stovky tisíc obrázkov, aby sme […]